Aviso de conteúdo sensível: este texto inclui descrições de comentários sexuais envolvendo menores de idade

Conteúdos que erotizam e sexualizam crianças e adolescentes seguem em circulação nas plataformas digitais na primeira semana de funcionamento do ECA Digital, conhecido popularmente como Lei Felca. A Lupa encontrou publicações que expõem menores a comentários com teor sexual no Facebook, Instagram, TikTok e Kwai, incluindo anúncios pagos, usados para aumentar o alcance nas redes.

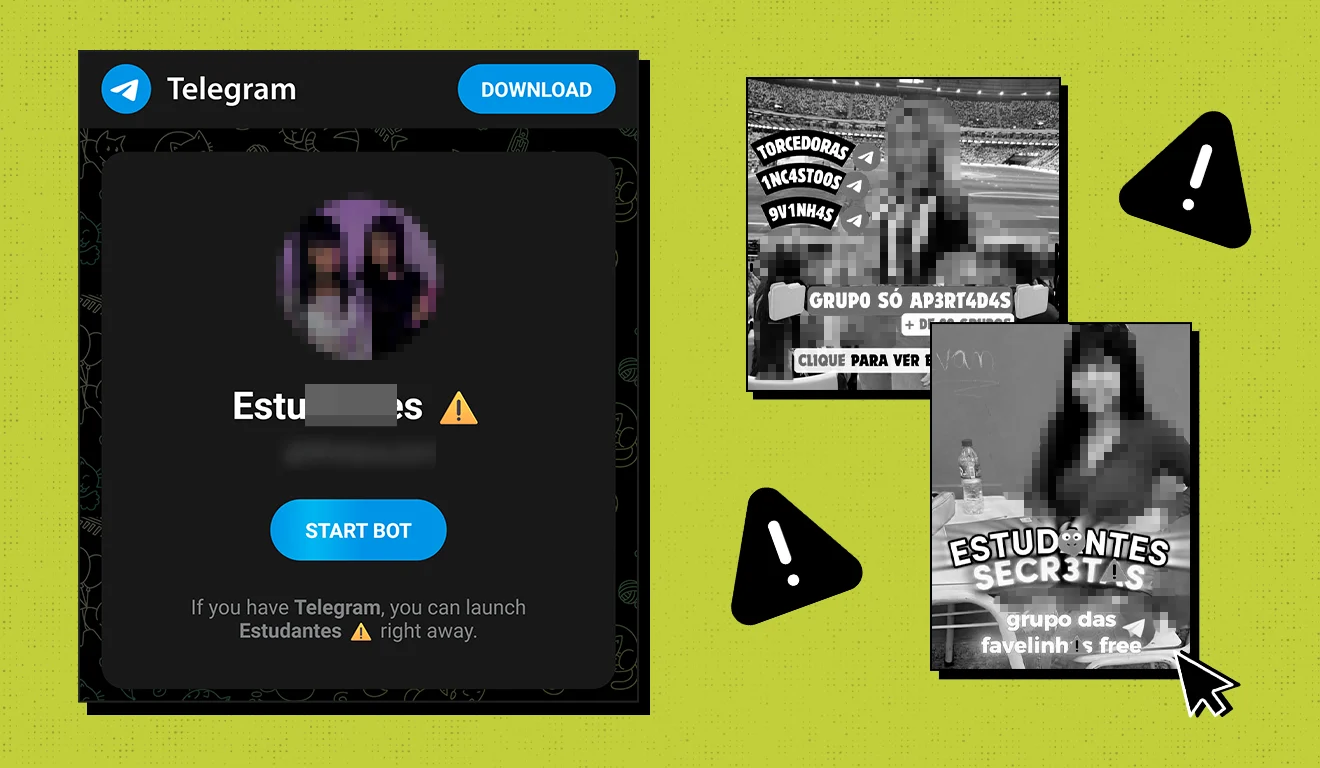

Entre os dias 17 (dia que a lei entrou em vigor) e 24 de março, foram identificados cinco perfis com publicações impulsionadas na Biblioteca de Anúncios da Meta (empresa que congrega o Instagram, Facebook, Threads e WhatsApp) com a promessa de “conteúdos vazados” de “novinhas, estudantes e incesto”. A monetização desse tipo de conteúdo é proibida pelo ECA Digital. Antes de serem divulgados nas redes, a Meta aprova quais anúncios podem circular.

Art. 23. São vedados aos provedores de aplicações de internet a monetização e o impulsionamento de conteúdos que retratem crianças e adolescentes de forma erotizada ou sexualmente sugestiva ou em contexto próprio do universo sexual adulto.

No Kwai e no TikTok, vídeos de adolescentes e crianças publicados após a vigência da lei foram alvo de perfis predatórios. Em um destes conteúdos, publicado no dia 21, constam comentários como “go_zei” e “delicinha. Princesinha linda”. Eles indicam que, apesar de o ECA Digital ter sido criado para evitar a exploração sexual infantil, perfis de menores de idade continuam vulneráveis a esse tipo de abordagem, ao menos nesta primeira semana.

Segundo a professora e pesquisadora em comunicação na Universidade de São Paulo (USP), Issaaf Karhawi, isso mostra como algoritmos de plataformas digitais cumprem um papel facilitador da exploração sexual infantil, mesmo após a lei. “Os algoritmos, quando a gente pensa na lógica de compartilhamento acelerado, potencializam essa circulação. É uma discussão urgente a ser feita”, declarou.

Para a psicóloga e co-fundadora da organização de educação digital com foco em proteção à criança Aldear, Nay Macêdo, a existência de comentários dias após a lei entrar em vigor indica uma insuficiência para lidar com o problema. “A velocidade da violência é muito maior que a velocidade da regulação, um ponto crítico, que nos faz reforçar a importância dos adultos cuidadores como primeira linha de defesa desses direitos”, afirmou.

Anúncios comercializam conteúdos de menores

Nos anúncios identificados na Biblioteca de Anúncios da Meta, garotas são retratadas com os rostos expostos e descritas como “estudantes”, parte delas, inclusive, em ambiente escolar. As legendas direcionam o usuário para grupos no aplicativo de mensagens Telegram, que recebem nomes em alusão a menores de idade, como “grupo novinha sub18” e “estudante”.

Anúncios e grupos semelhantes já haviam sido identificados pela Lupa em agosto, dias após o influenciador Felipe Bressanim Pereira, mais conhecido como Felca, expor como os algoritmos de plataformas digitais permitiram que conteúdos de crianças e adolescentes fossem alvo de criminosos e perfis predatórios. Na ocasião, foram encontrados 15 perfis com anúncios que erotizavam menores de idade — um volume três vezes superior ao identificado na busca atual.

Em nota à Lupa, a Meta (empresa dona do Facebook, Instagram, Threads e WhatsApp) afirmou que age “em total conformidade com a legislação vigente” e que atua de forma proativa para identificar conteúdos que violem as regras. “Entre outubro e dezembro de 2025, cerca de 97% das remoções no Instagram e do Facebook ocorreram por detecção de nossas próprias equipes, antes de qualquer denúncia”.

Ao direcionar os usuários para o Telegram, os anúncios levam a uma outra dinâmica, com um risco maior de exposição, avaliou Karhawi. “O ECA prevê proteger a integridade dos menores. Mas como fazer isso nos grupos que são fechados?”, questiona a pesquisadora. Para ela, esse papel cabe às plataformas. “É possível desenvolver algoritmos que diminuam o alcance de conteúdos sexualizados”, pontuou.

A Lupa também entrou em contato com o Telegram para questionar as medidas adotadas para evitar esse tipo de prática da plataforma. Em comunicado, a plataforma afirmou que existe uma dificuldade de monitorar conversas, pois os chats são criptografados.“

Vídeos de ‘dancinhas’ são alvo nas plataformas de vídeos curtos

No Kwai e no TikTok, onde os vídeos curtos de danças são populares, a Lupa verificou que a ferramenta de busca de ambas as plataformas permitem localizar conteúdos que expõem crianças e adolescentes, embora o ECA Digital exija medidas para prevenir o acesso de adultos a esse tipo de material.

Art. 6º Os fornecedores de produtos ou serviços de tecnologia da informação direcionados a crianças e a adolescentes ou de acesso provável por eles deverão tomar medidas razoáveis desde a concepção e ao longo da operação de suas aplicações, com o objetivo de prevenir e mitigar riscos de acesso, exposição, recomendação ou facilitação de contato com os seguintes conteúdos, produtos ou práticas:

I – exploração e abuso sexual;

II – violência física, intimidação sistemática virtual e assédio.

Publicados antes de o ECA Digital entrar em vigor, parte dos vídeos analisados foi alvo de interações predatórias.

Um dos perfis identificados demonstra como a exposição de menores extrapola fronteiras. Um dos perfis, pertencente a uma garota com mais de 10 mil seguidores, tem comentários em inglês e espanhol em vídeos nos quais ela aparece dançando. Mensagens como “Hola, bonita. Por favor cásate conmigo” e “Beautiful” aparecem em 2025. Outra, que diz “Hola que tal eres muy linda, hermosa”, foi publicada no dia 16 de março em um vídeo de dezembro, no qual a garota aparece de pijama.

O intervalo de três meses entre o post e o comentário reforça que perfis predatórios buscam gravações antigas para estabelecer contato e realizar abordagens inadequadas independentemente da data de publicação.

O acesso de perfis predatórios a conteúdos de crianças e adolescentes tende a acontecer por incentivo do próprio algoritmo das plataformas, como demonstrou o influenciador Felca em agosto. Na área de tecnologia, essa lógica é descrita como “comportamento do algoritmo” — a forma como o sistema processa dados para tomar decisões. Nas redes sociais, o mecanismo identifica as preferências do usuário a partir de visualizações e interações para, então, hierarquizar o que é exibido no feed.

Para Issaaf Karhawi, a reorganização desses mecanismos pelas plataformas é fundamental para criar filtros mais eficazes de proteção a menores. “No desenho do Instagram, que a gente tem inclusive dois feeds – de quem estamos seguindo e o algorítmico — já existe processo de hierarquia, moderação e filtragem das plataformas”, explica a pesquisadora.

Já na avaliação de Macêdo, da Aldear, a presença desses conteúdos não indica necessariamente uma falha imediata do ECA Digital, mas sim a baixa responsabilidade operacional das plataformas. “Elas precisam ser pressionadas a agir, assim como aconteceu com a indústria do tabaco ou do cinto de segurança”, compara.

Ainda não está claro se houve mudanças estruturais nos algoritmos após a vigência do ECA Digital. Desde que a lei entrou em vigor, o TikTok anunciou atualizações para ampliar a privacidade de usuários menores de 16 anos. A partir do dia 17 de março, todas as contas nessa faixa etária passaram a ser privadas por padrão, exigindo autorização dos responsáveis para se tornarem públicas.

Impacto no desenvolvimento de crianças e adolescentes

Segundo Macêdo, crianças e adolescentes muitas vezes não reconhecem a violência em situações de abordagem virtual, podendo interpretar comentários predatórios como validação positiva. “O cérebro adolescente não foi feito para lidar com isso. O sistema de recompensa é altamente sensível à validação social. O córtex pré-frontal (responsável pela tomada de decisão) está em desenvolvimento (nesta fase)”, afirma a psicóloga.

Para a especialista, a exposição digital faz com que adolescentes passem a medir o próprio valor pelo olhar externo, amplificado no universo digital. “Eles podem entrar em ciclos de validação, risco e vulnerabilidade”, acrescenta.

Somado a isso, a lógica atual das plataformas facilita que os conteúdos de menores sejam capturados para “aliciar, extorquir, produzir, armazenar ou disseminar material de abuso”, conforme apontou um estudo do Fundo das Nações Unidas para a Infância (Unicef) publicado este mês.

A Lupa identificou exemplos reais dessa disseminação persistente. É o caso de Caroliny Dreher, citada no vídeo do influenciador Felca em agosto. Na época, o perfil da adolescente – que continha vídeos de dança e ofertas de conteúdo “VIP” – foi removido. Apesar disso, suas gravações continuam em circulação por meio de perfis de terceiros.

Entre os dias 17 e 24, a Lupa encontrou mais de 30 contas que utilizam o nome e a imagem da garota para replicar o conteúdo original.

“As imagens, os comentários e todo o material mostram que existe, primeiro, uma captura silenciosa. Um estudo da Universidade Oberta da Catalunha junto com a Policia Nacional, por exemplo, fala em 72% das imagens em posse de predadores sexuais sendo retiradas de páginas de familiares”, destacou Macêdo.

“Depois, é atribuído um contexto sexualizado ao conteúdo para que, logo após, ocorra a circulação em redes, grupos, listas e espaços de ‘acesso premium’. A distribuição também inclui, como vimos, a linguagem codificada”, concluiu a psicóloga.

A Lupa também identificou um perfil em que uma mulher, que se apresenta como mãe de uma menina, publica uma série de conteúdos expondo a filha. A criança aparece em situações habituais: conversando, brincando, dormindo e falando com a câmera. Um dos vídeos, de novembro de 2025, acumula um milhão de visualizações. “Assim eu me apaixono”, comenta um usuário em um vídeo no qual a garota aparece deitada em um colchão.

“A imagem deixa de ser ‘uma criança dormindo’, ‘dançando’, ‘tirando foto’ e passa a ser tratada como objeto de desejo predatório”, disse Nay Macêdo sobre a configuração do pensamento do assediador. Para ela, o cuidado dos responsáveis começa no entendimento de que nem tudo pode ser publicado nas redes. “Perfis de meninas muitas vezes gerenciados por adultos, na maioria, são seguidos e monitorados por homens com comportamento predatório”, acrescentou.

Hashtags e palavras-chave

No X, a Lupa observou uma queda, após a implementação do ECA Digital, nas menções a hashtags usadas para compartilhar ou solicitar conteúdos que exploram sexualmente menores. Dados da ferramenta de monitoramento de redes sociais Meltwater indicam que perfis que costumavam usar essas tags foram excluídos pela plataforma.

Na semana anterior à implementação do ECA Digital, entre os dias 10 e 17, a Meltwater identificou cinco mil menções a duas hashtags utilizadas por assediadores e pedófilos. A quantidade foi reduzida para 4 mil na primeira semana da lei, entre os dias 17 e 24.

Plataformas, Estado e pais devem agir juntos, dizem especialistas.

Apesar de legislações anteriores ao ECA Digital — como o próprio Estatuto da Criança e do Adolescente (ECA) — já preverem proteção em todos os espaços, incluindo o virtual, a pesquisadora Issaaf Karhawi afirma que a nova lei esclarece como isso deve ser feito na internet. “O ECA Digital intensifica a discussão nesse sentido, deixando as regras muito mais claras e sem manobras”, disse.

“Por parte das plataformas, é preciso responder e atender as prerrogativas. Acho que é o ponto central”, pontuou. Para ela, também é necessário que outros atores sociais se responsabilizem pelo problema. “Tem a ver com um enfrentamento multisetorial: uma regulação adequada, responsabilização das plataformas e investimento em educação, espaços facilitados para a denúncia e acolhimento de famílias. É uma abordagem complexa e urgente”.

De acordo com o ECA digital, as plataformas devem tomar providências diante das denúncias dos usuários. Com a nova lei, o governo criou o Centro Nacional de Proteção à Criança e ao Adolescente, responsável por receber, classificar e encaminhar denúncias de crimes sexuais contra crianças e adolescentes. O órgão recebe as denúncias diretamente das plataformas e atua a partir delas.

“Ao identificar conteúdo criminoso, a plataforma deve removê-lo imediatamente, sem necessidade de ordem judicial prévia, e encaminhar o caso ao Centro, que atuará junto à Polícia Federal para investigar e tomar as medidas cabíveis”, detalhou o MJSP sobre o fluxo da denúncia.

Segundo o ECA Digital, no capítulo 15, se uma plataforma não cumprir as medidas, ela pode sofrer sanções que dependem da gravidade do caso. Inicialmente, a empresa pode receber uma advertência, com prazo de até 30 dias para adoção de medidas corretivas. Caso a irregularidade persista ou seja considerada mais grave, podem ser aplicadas multas que chegam a até 10% do faturamento da plataforma no Brasil.

Em situações mais severas, a legislação prevê a suspensão temporária das atividades ou até mesmo a proibição do exercício das atividades no país. A definição das penalidades leva em conta fatores como a extensão do dano, a reincidência e a capacidade econômica da empresa.

O que dizem as redes

A Lupa entrou em contato com Meta, TikTok, Telegram, Kwai e X para questioná-las sobre as mudanças nas plataformas após o ECA Digital. Apenas as três primeiras responderam até a publicação desta reportagem.

A Meta afirmou estar comprometida com a legislação e com a proteção de menores. “Nossas políticas contra exploração sexual, abuso e nudez infantil estão em total conformidade com a legislação vigente. Atuamos de forma proativa para identificar conteúdos que violem essas regras: entre outubro e dezembro de 2025, cerca de 97% dos das remoções no Instagram e do Facebook ocorreram por detecção de nossas próprias equipes, antes de qualquer denúncia”, diz a nota da empresa.

Já o TikTok informou que não permite conteúdos que coloquem jovens em risco de danos psicológicos, físicos ou de desenvolvimento, incluindo o compartilhamento, exibição, a promoção ou o envolvimento em abuso ou exploração. “Em nosso Centro de Transparência, publicamos trimestralmente relatórios de moderação. O mais recente, referente ao terceiro trimestre de 2025, aponta que 99,8% dos vídeos que violavam nossas diretrizes de abuso sexual e físico de jovens foram removidos proativamente, e 97,5% deles foram retirados do ar em menos de 24 horas”, informa a nota.

Em comunicado, o Telegram disse que não tolera o compartilhamento de materiais de abuso sexual infantil. A plataforma assumiu que existe uma dificuldade de monitorar conversas, pois os chats são criptografados. “Embora nenhuma plataforma criptografada possa monitorar proativamente chats privados, o Telegram processa denúncias de usuários e ONGs para aplicar seus termos de serviço lá. O fato de agentes mal-intencionados precisarem anunciar em outras plataformas significa que eles não conseguem existir publicamente no Telegram como resultado dos nossos esforços de moderação. Somente no ano passado, removemos mais de 952.318 materiais infratores”, disse o Telegram.

A Lupa segue com o espaço aberto para a resposta do Kwai e X.

PayPal

PayPal